Inledning

De senaste veckorna har det dykt upp en hel del ledare i bland annat Svenska Dagbladet och i Göteborgsposten om en kommande EU-förordning, känd som Chat Control av sina kritiker (ett namn jag kommer använda eftersom förordningens namn är lite väl långt), som enligt artikelförfattarna kommer att möjliggöra massövervakning av alla typer av digitala kommunikationsverktyg. Allt i det heliga korståget mot den fruktansvärde pedofilen. Ett nobelt syfte, men frågan är hur mycket vi borde offra i detta korståg?

Enligt Ylva Johannsson, som är den svenska EU-kommissionär som driver på lagförslaget så handlar förslaget inte alls om att införa en massövervakning. Utan det ska handla om en möjlighet att hitta särskild information utan att det ska påverka den personliga integriteten.

Sättet som den här informationen ska hittas redogörs för i lagförslagets 10:e artikel. Där finns en beskrivning av de teknologierna som ska användas för att hitta informationen i fråga. Teknologierna ska vara:

- Effektiva i upptäckten av disseminering av känt eller nytt barnpornografimaterial, eller grooming;

- Oförmögna att extrahera någon annan information från kommunikationerna utom den informationen som är strikt nödvändig för att upptäcka sånt som utgör barnpornografibrott eller grooming;

- ”State of the art” och vara minst inskränkande i den enskildes privat- och familjeliv, inbegripet konfidentiell kommunikation och för att skydda personuppgifter;

- Tillräckligt pålitlig, i det att de begränsar felmarginalen så lång som möjligt i detekteringen.

Lagförslaget i sig ska alltså bara kunna upptäcka material som är brottsligt i jakten på pedofilen, och allt annat ska vara fredat och vi som inte identifierar oss som pedofiler ska kunna kommunicera precis som vanligt.

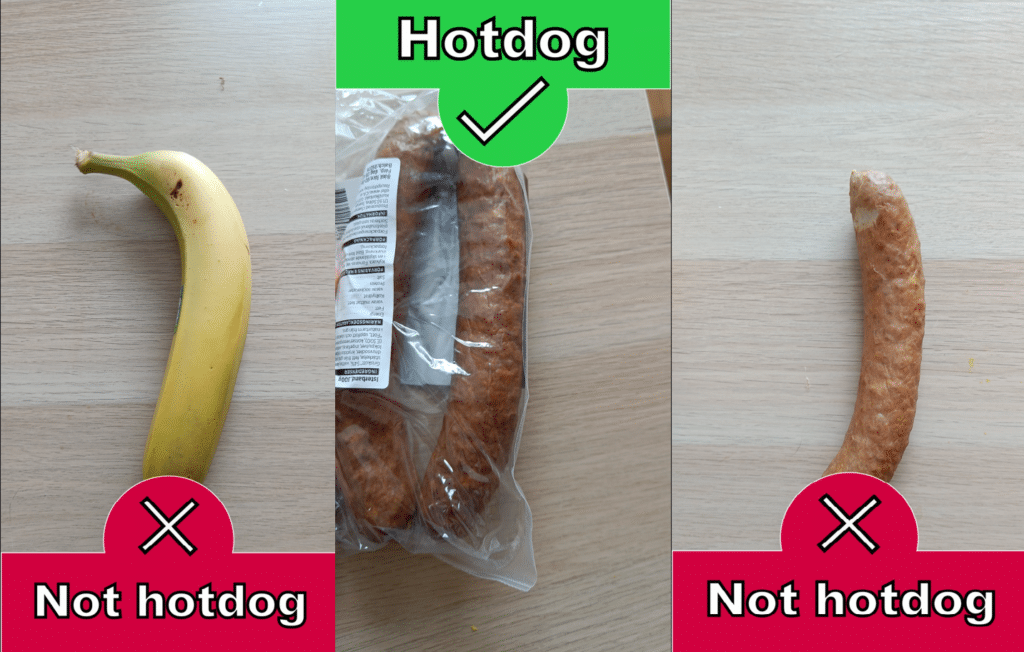

Jag föreställer mig att en slags bildigenkänningsteknologi behövs. Motsvarande den i appen Not Hotdog – SeeFood.

I mitt stilla sinne känns det som att det saknas ett steg mellan den massövervakning som Henrik Alexandersson skriver om i SVD tillika Emanuel Karlsten i GP. För strikt taget, om det skulle gå att genomföra förslaget med de stegen som finns utan att det nämnvärt påverkar den enskildes privat- och familjeliv, samtidigt som konfidentiell kommunikation kan fortsätta vara konfidentiell och om felmarginalen hålls mycket låg. Ja då kan nog förslaget vara helt rimligt att genomföra. Nyckelordet är om.

Vad säger experten?

Eftersom jag själv inte är IT-säkerhetsspecialist så är jag inte rätt person att fråga om kravet på den teknologi som redogörs för är realistiskt. Därför ställde jag några frågor om kraven ovan till Karl Emil Nikka, grundare av Nikka systems, författare av boken ”Bli Säker” och motståndare till lagförslaget.

Första frågan:

JS: Är det möjligt att ha en effektiv detektering i enlighet med 10.3 a) och samtidigt bibehålla konfidentiell kommunikation?

KEN: Det är uppenbart att svaret är nej. För att en leverantör av chattjänster, till exempel Signal, ska kunna följa artikel 10.3 måste de först ha tillgång till konversationer i dekrypterat skick.

Andra frågan:

JS: Är det möjligt att ha en effektiv detektering som inte kan användas för något annat än att upptäcka barnpornografimaterial eller groomingförsök?

KEN: För att kunna skanna efter den typen av bilder och konversationer som avses i lagförslaget måste leverantören ha tillgång till chattmeddelandena, och då finns det ingen teknisk begränsning för vad de kan leta efter.

Tredje Frågan:

JS: Vad kan man räkna med för felmarginal i den typen av teknologi som används för den här typen av detektering?

KEN: Teknologin finns inte, så det kan jag inte svara på. Förslaget hänvisar till teknik som EU-centret ska bidra med, men mjukvaran finns ju inte än.

Omformulering:

JS: Vad kan man räkna med för felmarginal i den typen av bildigenkänningsteknologi som används för att upptäcka barnpornografi och groomingförsök idag?

KEN: För bilder som redan är kända är felmarginalen mycket låg, även om bilden har ändrats lite grand så kan en dator känna igen den. Problemet uppstår främst när det är nytt material som delas. Artificiell intelligens kan inte se skillnad på en 17-åring som blir utnyttjad och en 19-åring som sextar (sexchattar /reds anmärkning).

KEN: Den statistik jag känner till kommer från schweiziska Fedpol, de publicerar hur många anmälningar de fått från NCMEC och hur många av de anmälningarna som har kunnat användas för att lagföra brott. I den senaste statistiken så har ca 20 % av anmälningarna kunnat användas.

Vad betyder det här egentligen?

Jag brukar ofta beskriva IT-rätt som en myt, eftersom det är samma regler som gäller på nätet och i den digitala världen som de som gäller i vår fysiska och mer greppbara verklighet. För att förstå konsekvenserna av förslaget kan det därför vara värt att översätta Nikkas svar till vår fysiska verklighet. Att skicka brev blir den bästa analogen.

På fråga ett så svarar Nikka att posten på grund av den här lagen kan bli tvungna att öppna dina brev. Fast inte för att du är kriminell eller att det finns skälig misstanke riktad mot dig. Utan för att en myndighet har beslutat att posten kan användas för att skicka olagliga bilder. Det spelar då ingen roll vem som skickar bilderna, allt ska öppnas. Om ditt brev har öppnats av någon annan innan du får det, är innehållet konfidentiellt då? Mitt svar är nog nej på den frågan, men jag är öppen för att andra tolkningar finns.

På den andra frågan så svarar Nikka att när posten öppnat ditt brev, då kan de också läsa ditt brev. Alldeles oavsett vad som står i brevet. Plötsligt öppnas grinden för att leta efter annat material som kan uppfattas som olämpligt eller olagligt. Makthavarna får därmed möjligheten att kartlägga och hitta avvikande personer, som till exempel homosexuella, folk som röstar på fel parti, personer som är med i fackföreningar eller personer som av någon annan anledning begår tankebrott. Storebrors våta dröm helt enkelt.

Slutligen uppger Nikka att den som öppnar breven på posten inte berättar hur många brev som faktiskt innehåller olagligt material. Den som öppnar breven saknar helt och hållet magkänsla för vad som är olagligt material. Antingen känner hen igen materialet som olagligt för att chefen har visat bilden förut och berättat att ”den här bilden är olaglig”. Men om det kommer en ny bild så måste den anställde gissa och hoppas. I ett av fem fall gissar den anställde rätt, och materialet är olagligt. En AI som scannar våra chattar kan alltså jämföras med en praoelev på posten som ska leta efter olagligt material. Alltså ingen som borde fatta viktiga beslut. Nu vill Ylva Johansson göra praoeleven till myndighetschef.

Slutsatsen

Förslaget som Ylva Johansson har lagt fram och som hon fortfarande står bakom skulle alltså göra det mer eller mindre omöjligt att föra någon form av dialog digitalt utan risken att bli avlyssnad, pedofil eller ej. Lagförslaget skulle alltså vara i direkt konflikt med den grundlagstadgade rättigheten i Regeringsformen att bli skyddad mot undersökning av brev eller annan förtrolig försändelse. Detta av den enkla anledningen att teknologin som krävs för att hitta material i en förtrolig försändelse utan att ta del av försändelsen inte existerar. Även om den skulle finnas så illustrerar isterbandsbilderna ovan just problematiken med bildigenkänningsteknologi: om den inte redan vet svaret, så har den ofta fel (se denna artikel om ett vanligt problem med ansiktsigenkänning för ytterligare exempel).

Min uppfattning är, med tanke på det jag skrivit, att Chat Control inte verkar vara ett särskilt väl genomtänkt förslag. För att införa den här typen av begränsningar i våra rättigheter så behöver begränsningen stå i proportion till det man vill åstadkomma. Som det är beskrivet i Europakonventionens 8:e artikel så ska begränsningar i vårt privatliv och intrång i vår korrespondens vara ”nödvändiga i ett demokratiskt samhälle”. Att övervaka oss alla, eller ge sig själv möjligheten att övervaka oss alla, för att komma åt en bråkdel av oss känns snarare som något som görs i diktaturer än i välfungerande demokratier. Om Ylva Johansson vill jaga pedofiler, så tycker jag därför att hon kan få göra det på ett sätt som inte leder till att alla mina digitala brev blir öppnade. Det är mina brev, du behöver inte läsa dem Ylva.